SNACK AI 3강: 과적합과 제한적 볼츠만 머신

소요시간

약 12분

이 글을 읽으면…

- •과적합(Overfitting)의 개념과 문제점을 이해할 수 있어요.

- •그레디언트 소실 문제를 설명할 수 있어요.

- •제한적 볼츠만 머신(RBM)의 역할을 이해할 수 있어요.

딥러닝의 문제점과 해결책

딥러닝이 강력한 기술이지만, 몇 가지 심각한 문제점이 있었습니다.

이번 강의에서는 과적합과 그레디언트 소실 문제, 그리고 이를 해결한 제한적 볼츠만 머신에 대해 알아봅니다.

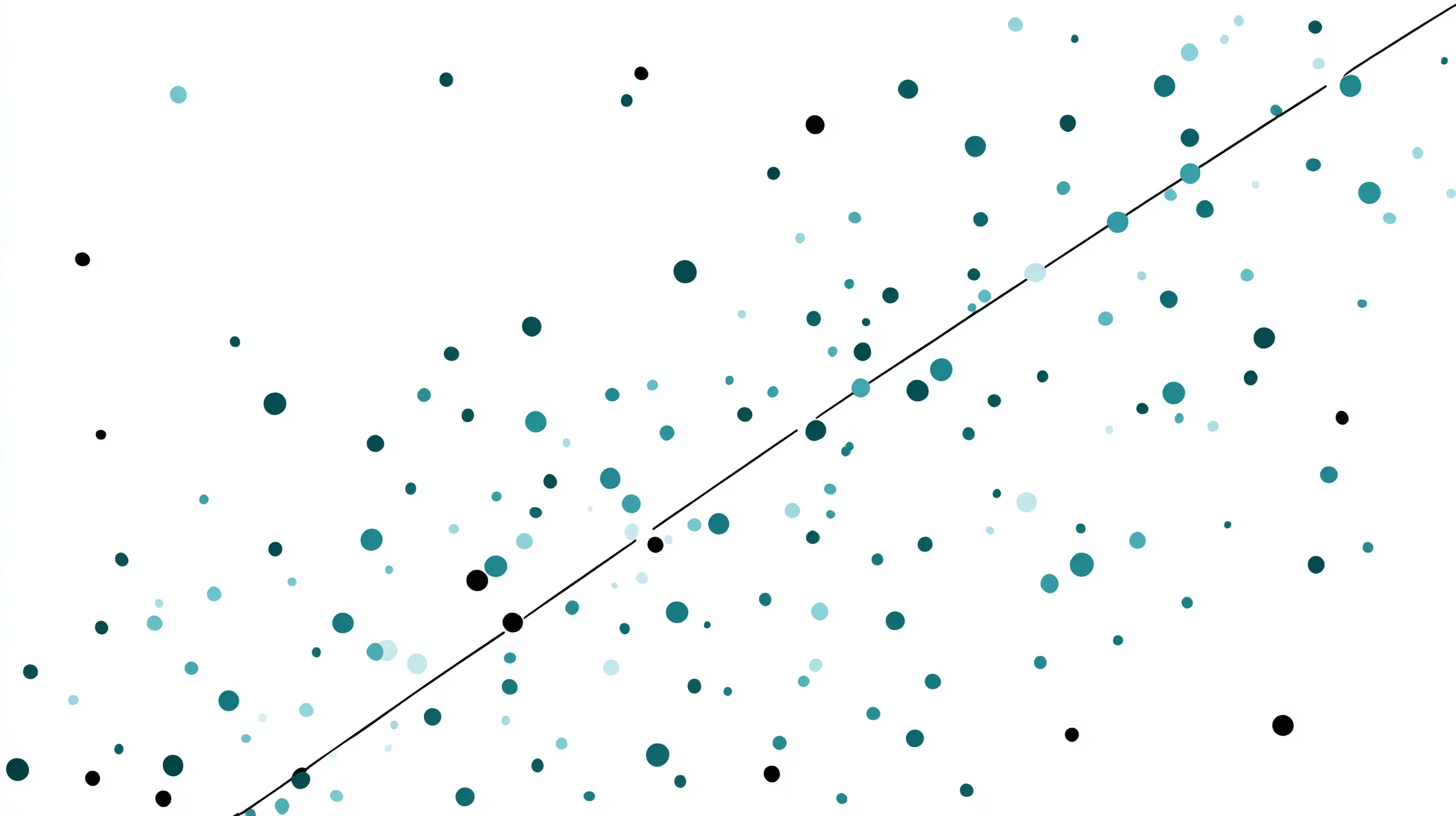

1. 과적합(Overfitting)이란?

과적합은 모델이 훈련 데이터에 너무 잘 맞춰져서, 새로운 데이터에는 제대로 작동하지 않는 현상입니다. 마치 시험 문제만 달달 외워서 응용 문제를 못 푸는 것과 같아요.

- 훈련 데이터: 정확도 99%

- 새로운 데이터: 정확도 60%

- → 이런 경우가 과적합입니다!

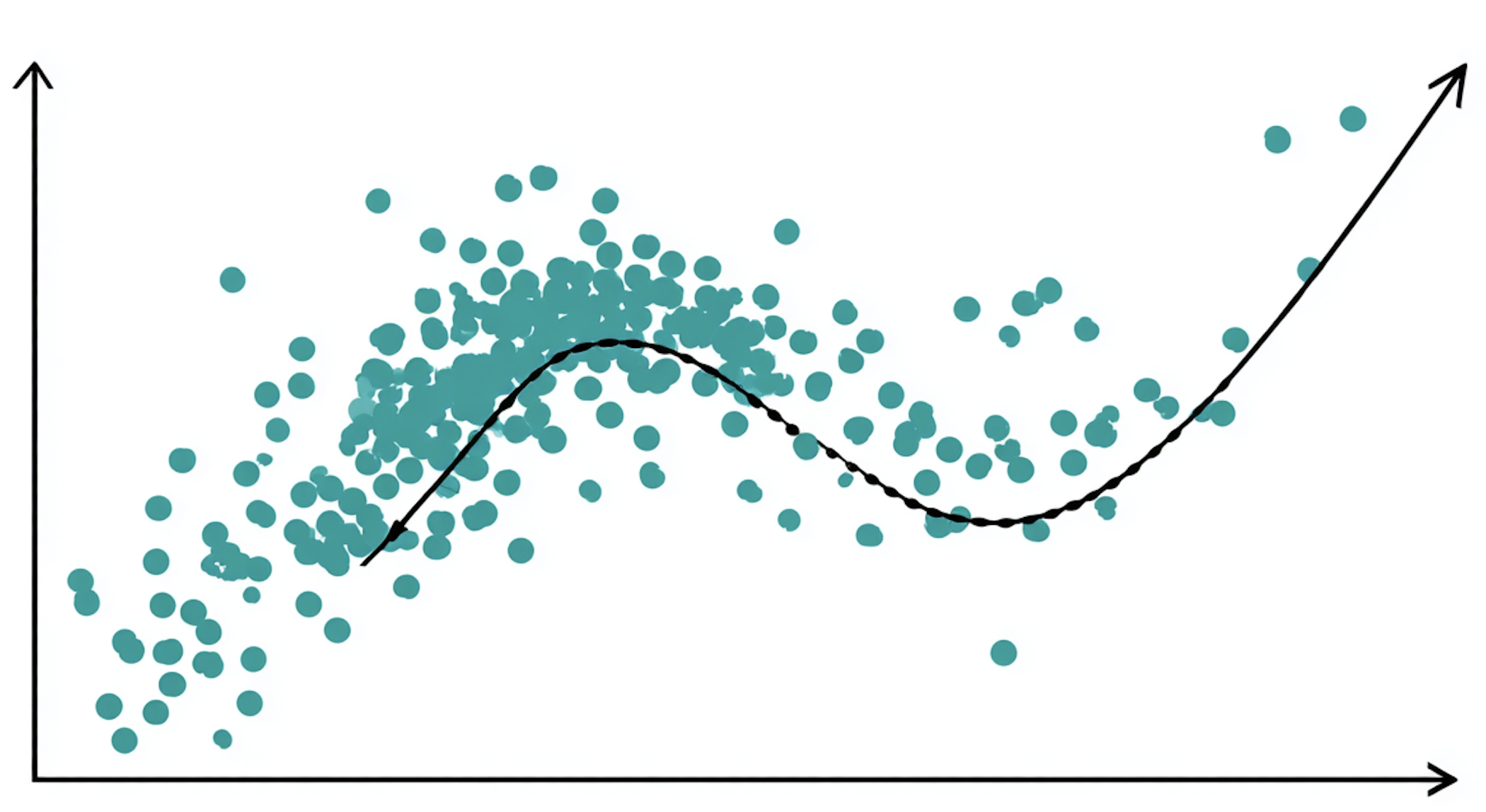

2. 그레디언트 소실 문제

그레디언트 소실(Vanishing Gradient)은 신경망이 깊어질수록 학습 신호가 약해지는 문제입니다. 역전파 과정에서 그레디언트가 점점 작아져서 앞쪽 층이 제대로 학습되지 않습니다.

층이 깊어질수록 → 그레디언트가 작아짐 → 앞쪽 층이 학습 안 됨 → 성능 저하

3. 제한적 볼츠만 머신(RBM)

제한적 볼츠만 머신(Restricted Boltzmann Machine)은 이러한 문제들을 해결하기 위해 제안된 방법입니다. 비지도 학습으로 각 층을 미리 훈련시켜 좋은 초기 가중치를 찾습니다.

- 사전 훈련(Pre-training): 각 층을 순차적으로 비지도 학습

- 미세 조정(Fine-tuning): 전체 네트워크를 지도 학습으로 조정

- 결과: 더 나은 초기 가중치로 학습 효율 향상

4. 현대 딥러닝의 해결책들

RBM 이후로 다양한 기술들이 개발되어 이러한 문제들을 더 효과적으로 해결하고 있습니다.

- ReLU 활성화 함수: 그레디언트 소실 완화

- 드롭아웃(Dropout): 과적합 방지

- 배치 정규화(Batch Normalization): 학습 안정화

- 데이터 증강(Data Augmentation): 훈련 데이터 다양화

오늘의 핵심 정리

- 과적합은 모델이 훈련 데이터에만 잘 맞고 새 데이터에 약한 현상입니다.

- 그레디언트 소실은 깊은 신경망에서 학습 신호가 약해지는 문제입니다.

- RBM은 사전 훈련으로 좋은 초기 가중치를 찾아 문제를 해결했습니다.

- 현대에는 ReLU, 드롭아웃 등 다양한 기술로 이 문제들을 해결합니다.

확인 퀴즈(Flash card)

Question

훈련 데이터에는 잘 맞지만 새 데이터에는 성능이 떨어지는 현상은?

클릭하여 정답 확인

Answer

과적합(Overfitting)

클릭하여 문제로 돌아가기

Question

깊은 신경망에서 역전파 시 학습 신호가 약해지는 문제는?

클릭하여 정답 확인

Answer

그레디언트 소실(Vanishing Gradient)

클릭하여 문제로 돌아가기

Question

비지도 사전 훈련으로 초기 가중치를 찾는 방법은?

클릭하여 정답 확인

Answer

제한적 볼츠만 머신(RBM)

클릭하여 문제로 돌아가기